(Foto: Gerd Leonhard)

Algoritmes. Wij hebben allemaal een vaag idee wat hiermee bedoeld wordt, maar vaak blijft het bij een idee over robots, automatisering en iets met computers of data. Wikipedia levert ook geen duidelijk uitsluitsel: een algoritme wordt omschreven als ‘een eindige reeks instructies die vanuit een gegeven begintoestand naar een beoogd doel leidt’. Dus dat.

Nu is mijn reactie als niet-techneut vaak ‘oh, laten we dit soort dingen maar over aan mensen die er verstand van hebben, ergo aan informatici en technici’. Zij zullen wel weten hoe die dingen werken en er op een verstandige manier mee omgaan. Er komt echter steeds meer aandacht voor de schaduwkanten van algoritmes en wat er gebeurt wanneer wij als maatschappij deze technologie in de handen van informatici laten. Waar algoritmes lange tijd vooral werden gebruikt door technologische bedrijven, zoals de bekende Facebook en Google, worden zij inmiddels ook ingezet in de dagelijkse praktijk. En dit levert problemen op. Een recent voorbeeld hiervan is de zelfrijdende auto die zwarte mensen niet als mens herkent. Dit wordt veroorzaakt door een algoritme dat alleen gewend is om witte mensen te herkennen.

Hoog tijd dus dat we stil gaan staan bij de rol van algoritmes in onze maatschappij, zeker wat betreft de discriminerende kant van deze technologie. Daarom werd er in de Rode Hoed een avond georganiseerd met als onderwerp ‘Het discriminerende algoritme’. Vijf sprekers, neuro-informaticus Sennay Ghebreab, AI-consultant Walter Diele, D66-kamerlid Kees Verhoeven en – middels een live videoverbinding – Ruha Benjamin, hoofddocent African American Studies aan Princeton University, gingen met elkaar in gesprek over dit onderwerp onder leiding van moderator Alberta Opoku.

De mogelijkheden en onmogelijkheden van het algoritme

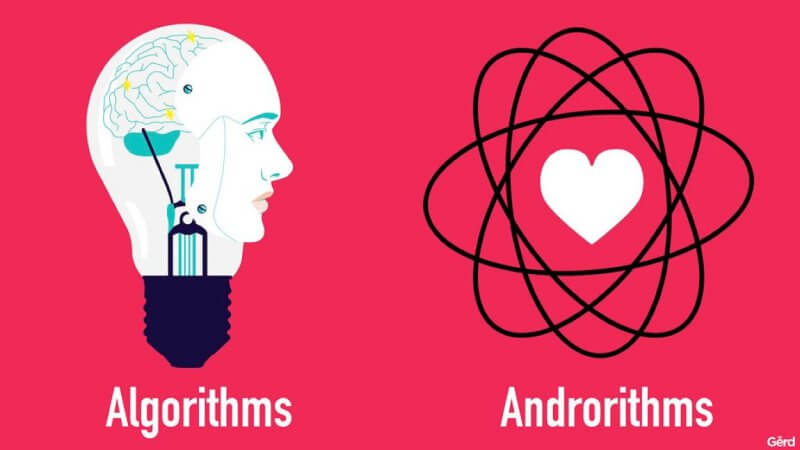

Volgens Walter Diele moeten wij niet zo bang zijn voor algoritmes. Wij moeten algoritmes en computers vooral zien als hulpmiddel, als iets dat kan wat wij niet kunnen en dus niet als iets wat een bedreiging voor ons zou kunnen vormen. Mensen kunnen nooit zoveel data verzamelen als een computer, maar een computer of algoritme gaat nooit in staat zijn dingen als empathie of moraliteit te begrijpen. Daarvoor mist een computer enig semantisch begrip.

Zoals het een echte bedrijfsconsultant betaamt ziet Diele in algoritmes vooral kansen voor het bedrijfsleven. ‘Algoritmes maken het makkelijker te categoriseren en zorgen ervoor dat bijvoorbeeld een bank beter kan inschatten wie een lening krijgt op basis van alle gegevens die een bank bezit van zijn klanten.’ Hierbij lijkt hij dus te veronderstellen dat het besluit van een bank om een lening uit te keren vooral gebaseerd is op het verzamelen van data. Dat er vaak morele, creatieve en empathische kanten zitten aan zo’n besluit, lijkt hij daarbij te vergeten.

Daarmee vertolkt Walter Diele het geluid van de bedrijvensector ten aanzien van het gebruik van algoritmes. Algoritmes maken het nog makkelijker morele en empathische besluiten buiten de deur te houden; de besluiten zijn immers geveld door een algoritme. Het algoritme moet wel geschikt zijn voor de juiste situatie; er ontstaat discriminatie wanneer dit niet het geval is. Deze discriminatie is dan de schuld van het algoritme, of van het onjuiste model dat het gebruikt. Hiermee wordt discriminatie gereduceerd tot het onjuist werken van een patroon voor een andere situatie dan waarvoor het gemaakt is. De nadelen van een algoritme volgens Diele ontstaan dus vooral wanneer een bepaald model op een compleet andere situatie wordt toegepast.

De weigerende draaideur

Sennay Ghebreab, neuro-informaticus, ziet dit echter heel anders. Ooit zelf geconfronteerd met het discriminerende algoritme – hij werd geweigerd door een draaideur vanwege zijn huidskleur – bepleit hij dat algoritmes juist menselijke discriminatie versterken. Het zijn niet de algoritmes zelf die discrimineren en er is ook meestal geen sprake van een kwade geest achter discriminatie door algoritmes. Discriminatie is eerder het gevolg van een onbedoelde vooroordeel in de data voor het algoritme. Voor Ghebreab is een algoritme daarmee een spiegel van de fouten die mensen maken.

Ruha Benjamin staat hem hierin bij. Volgens Benjamin zit het gevaar van algoritmes vooral in menselijke besluitvorming, zoals in sollicitatieprocedures. Algoritmes versterken de fouten die mensen maken. Hoewel Benjamin vooral haar zorgen uit over de praktijken in Amerika is haar verhaal ook voor Nederland van toepassing. Volgens D66-kamerlid Kees Verhoeven is er sprake van een ‘wildgroei aan algoritmes door lagere overheden’ en zijn gemeentes niet kritisch genoeg over het gebruik ervan.

De paniek van de politiek

Verhoeven vertolkt met zijn kritiek de vrees van veel mensen voor algoritmes. Deze vrees is misschien wel terecht, want door de vooroordelen die algoritmes met zich meedragen ontstaat er inderdaad in de praktijk discriminatie. Daarom belooft Verhoeven de toeschouwers in de zaal dat de politiek actie zal ondernemen om het gebruik van algoritmes in de besluitvorming meer in te perken en van strengere regels te voorzien. Verhoeven ziet dus mogelijkheden om algoritmes in hun huidige staat te behouden. Wanneer Ghebreab oppert dat algoritmes juist kunnen worden gebruikt om ongelijkheid aan de kaak te stellen en om deze te bestrijden, reageert Verhoeven bijna paniekerig: ‘Eerst moeten we begrijpen hoe algoritmes werken en de problemen met algoritmes oplossen.’

Ghebreab stelde als reactie op Verhouden de vraag waarom het in de politiek altijd of-of is. Een terechte vraag, want waarom beschouwt de politiek algoritmes alleen maar als gevaar? Uit de reactie van Verhoeven blijkt ook dat hij niet erkent wat het daadwerkelijke gevaar is van algoritmes. Dit zijn niet de algoritmes zelf; nee de mens is het eigenlijke gevaar. Zoals zo vaak is het makkelijker om de schuld en daarmee de verantwoordelijkheid af te schuiven, door de technologie aan te pakken. Hierbij wordt echter niet gekeken waar de discriminatie vandaan komt.

Ghebreabs pleidooi om algoritmes te gebruiken in het aantonen van discriminatie is dus geen blind vertrouwen in de technologie, maar een terecht wantrouwen tegen de mens. Het wordt tijd dat de politiek zich beseft dat discriminatie iets is wat urgent is en wat nu een aanpak nodig heeft. Het zijn niet de algoritmes waarvoor de politiek bang moet zijn, maar over het gebruik van algoritmes door mensen.

Tips voor de toekomst met algoritmes

De avond werd afgesloten door de vraag van de moderator of de sprekers nog tips hebben voor de toehoorders. Naast leestips – volgens Verhoeven moeten wij allemaal massaal Daniel Kahneman gaan lezen – volgen er tips als ‘data-besef’, ‘ga van Facebook af’, ‘verdiep je in kunstmatige intelligentie’. De oproep naar meer diversiteit in tech-bedrijven komt ook niet als een verrassing, net zo min als de oproep om data minder ‘biased’ te maken. Alweer is Gheabreab de vreemde eend in de bijt. Waar Verhoeven pleit voor voorzichtigheid met technologie, roept hij op om vooral te leren van technologie. Mens en technologie moeten niet van elkaar losgetrokken worden. Niet het algoritme discrimineert, maar de mens.

Hoewel ik het voor een groot deel met Gheabreab eens ben aan het einde van de avond, zijn er wel enkele zorgen met betrekking tot algoritmes blijven hangen. Zo stelde een informaticadocente een vraag, waarvan ik nogal schrok. Zij vroeg zich af of technici en informatici ethiek moesten krijgen tijdens hun opleiding, aangezien dit nu niet het geval is. Het feit dat diegenen die de algoritmes ontwikkelen geen ethiek krijgen en daarnaast niet kritisch nadenken bij de technologie die zij ontwikkelen, laat volgens mij zien dat wij met technologie de verkeerde kant op gaan. Het is inderdaad niet zo dat de technologie kwaadaardig is, maar er zonder nadenken mee omgaan kan wel kwaadaardige gevolgen hebben.

Naast Gheabreabs pleidooi voor meer bewustzijn over discriminatie, moet er ook een maatschappelijk debat komen over het gebruik van technologieën als algoritmes. Dit maatschappelijke debat moet echter niet alleen in de politiek plaatsvinden, maar ook zeker op het gebied van de informatici zelf. Hoog tijd dus dat er wat minder techniek en wat meer filosofie wordt geleerd.

Tekst: Zoë Spaaij